以下参考cc-switch里面一位佬提交的 issue 中的方法、官方文档和其他佬友帖子进行总结

cc-switch BYOK 本地设置

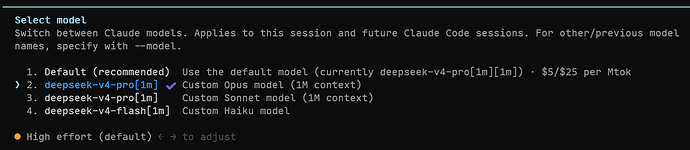

在 cc-switch 按照下面这样设置虽然 /context 后都能正确打开 1m 的上下文,但是 /model 会在默认模型里面出现两个 [1m][1m] 的抽象显示情况,就是因为 model:预设对应模型 本身就是默认开启对应模型1m的上下文窗口, Claude Code 里 [1m] 是上下文窗口大小的语法标记,它会把 model: opus 中 opus 对应填的 deepseek-v4-pro [1m] 解析为:

模型名 = deepseek-v4-pro + 上下文 = 1m ,然后在显示时再拼一次,所以变成 deepseek-v4-pro [1m] [1m]。

[推广] 免费送奖品价值超万元:程序员 VIbe Coding 最佳搭子,行走式编程最佳形态!

[推广] 免费送奖品价值超万元:程序员 VIbe Coding 最佳搭子,行走式编程最佳形态!

"env": {

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "api",

"ANTHROPIC_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash[1m]",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro[1m]",

"CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-flash[1m]",

"CLAUDE_CODE_EFFORT_LEVEL": "max",

"CLAUDE_AUTOCOMPACT_PCT_OVERRIDE": "80"

},

"model": "opus",

参考了github的issue 提醒:DeepSeek 1M 上下文在 CCS 本地路由模式下不要填写 [1m] 后缀 · Issue #2337 · farion1231/cc-switch · GitHub

以及 以下官方文档

$env:ANTHROPIC_BASE_URL="https://api.deepseek.com/anthropic"

$env:ANTHROPIC_AUTH_TOKEN="<你的 DeepSeek API Key>"

$env:ANTHROPIC_MODEL="deepseek-v4-pro[1m]"

$env:ANTHROPIC_DEFAULT_OPUS_MODEL="deepseek-v4-pro[1m]"

$env:ANTHROPIC_DEFAULT_SONNET_MODEL="deepseek-v4-pro[1m]"

$env:ANTHROPIC_DEFAULT_HAIKU_MODEL="deepseek-v4-flash"

$env:CLAUDE_CODE_SUBAGENT_MODEL="deepseek-v4-flash"

$env:CLAUDE_CODE_EFFORT_LEVEL="max"

确实是需要将模型名加上[1m]才可以开启1m的上下文,因此只要把默认模型对应的opus设置成deeseek-v4-pro就可以了,切opus就是200k的上下文,切切其他的模型就是1m,其中default模型会拼接 opus:deeseek-v4-pro +默认预设[1m] 即可开启1m上下文。

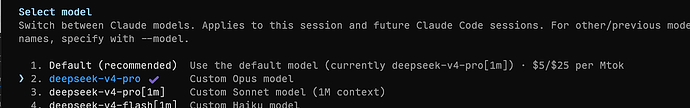

最终设置如下:

"env": {

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "api",

"ANTHROPIC_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash[1m]",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro",

"CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-flash[1m]",

"CLAUDE_CODE_EFFORT_LEVEL": "max",

"CLAUDE_AUTOCOMPACT_PCT_OVERRIDE": "80"

},

"model": "opus",

含义:

- model: “opus” 表示默认启动时使用 opus 槽位,即 deepseek-v4-pro

- effort: max 开启最高推理能力,autocompact: 80 表示上下文到 80% 触发自动压缩

- 只有opus没开[1m]作为claude code默认模型,此时不会出现显示两个[1m]的情况,作为默认只有200k上下文,其他都能打开1m的上下文

cc-switch 本地路由/代理设置

Claude Code 里 [1m] 是上下文窗口大小的语法标记,我们直接在default留空即可。

Default 留空后,进入 Claude Code 时会自动使用 Claude Code 自己的默认 Opus 模型;这个模型本身就是 Claude Code 支持 1M 上下文的预设,刚好可以通过 CCS 的 Opus 映射转发到 DeepSeek 的真实上游模型名 提醒:DeepSeek 1M 上下文在 CCS 本地路由模式下不要填写 [1m] 后缀 · Issue #2337 · farion1231/cc-switch · GitHub 。

主模型 / ANTHROPIC_MODEL / Default model:留空

Haiku:deepseek-v4-pro

Sonnet:deepseek-v4-pro

Opus:deepseek-v4-pro

因此不要把 ANTHROPIC_MODEL 固定成 deepseek-v4-pro;只保留需要的模型族映射即可,例如:

{

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro"

}

参考其他佬友的帖子:

今天倒腾了一下 Claude Code 直连官方 Deepseek 的配置,目标是启动 1M 上下文和默认启动 Max thinking mode. 最终配置流程: 下载 Claude Code 去 Deepseek API 申请 API key 并充值 打开 ~/.claude/settings.json (Ubuntu, 其他系统应该也是找类似的配置文件) 写入: { …

[图片] 在没有开启 ccs 的本地代理时 需要在主模型和 Haiku 后面添加 [1m] sonnet 和 opus 无需额外添加 [1m] 以下是对比图 [图片] [图片] 详情可以查看以下回复:

Environment variables - Claude Code Docs

Complete reference for environment variables that control Claude Code behavior.

github.com/farion1231/cc-switch 提醒:DeepSeek 1M 上下文在 CCS 本地路由模式下不要填写 [1m] 后缀 已打开 05:58PM - 25 Apr 26 UTC 已关闭 02:02PM - 27 Apr 26 UTC这个问题用于补充 DeepSeek BYOK + Claude Code + CC Switch 本地路由模式下的配置说明。 下方两条评论分别说明: 1. …推荐配置做法 2. Claude Code 与 CC Switch 的代码证据

1 个帖子 - 1 位参与者