人工智能标准与创新中心(CAISI)近日完成了对开源人工智能模型 DeepSeek V4 Pro的全面评估。报告指出,尽管DeepSeek V4展示了卓越的性能,并在多项指标上大幅领先于国内同类模型,但其综合能力相较于美国最前沿技术仍有约8个月的代差。

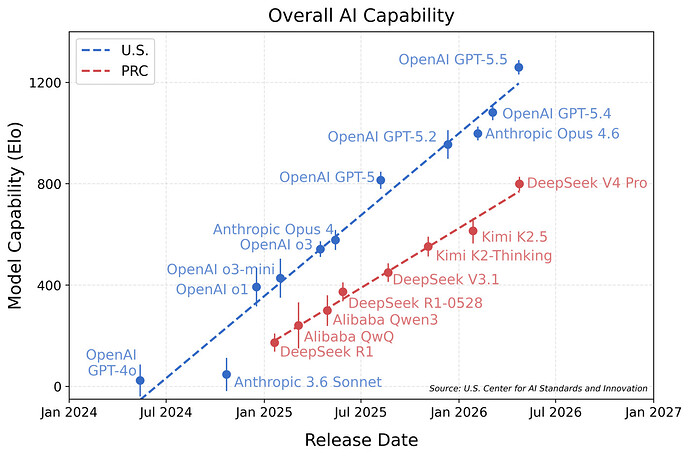

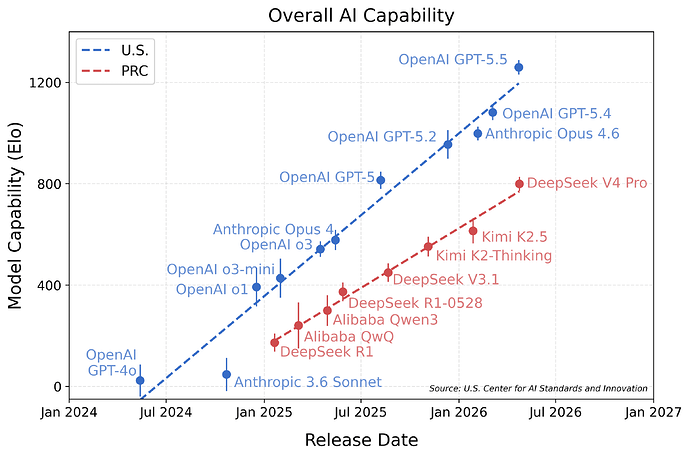

CAISI的IRT(项目反应理论)模型显示,DeepSeek V4的综合Elo得分约为800分。这一水平与美国约8个月前发布的GPT-5性能相当,但明显落后于当前的领先模型GPT-5.5(Elo 1260)和GPT-5.4(Elo 1070)。

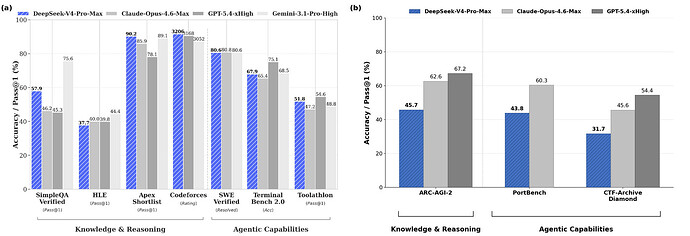

尽管DeepSeek官方报告称其性能已追平GPT-5.4,但CAISI在非公开基准测试(如ARC-AGI-2半私有数据集、PortBench)中的评估显示,DeepSeek V4在抽象推理和复杂软件工程任务上表现疲软,落后于美国顶尖机型。

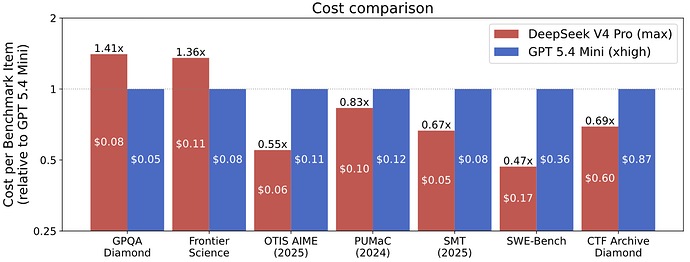

在成本效益方面,DeepSeek V4表现亮眼。在与功能相近的美国模型(GPT-5.4 mini)对比中,DeepSeek在七项基准测试中的五项均具有价格优势,成本降低幅度在41%至53%之间。

CAISI对DeepSeek V4在网络安全、软件工程、自然科学、抽象推理和数学五个领域进行了深度测试:

评估领域 代表性基准测试 DeepSeek V4 准确率 领先模型对比 (GPT-5.5) 数学 OTIS-AIME-2025 97% 100% 数学 PUMaC 2024 96% 96% 数学 SMT 2025 96% 99% 自然科学 GPQA-Diamond 90% 96% 自然科学 FrontierScience 79% 74% 软件工程 SWE-Bench Verified 74% 81% 软件工程 PortBench 44% 78% 抽象推理 ARC-AGI-2 (半私有) 46% 79% 网络安全 CTF-Archive-Diamond 32% 71%分析指出,DeepSeek V4在数学和自然科学领域已非常接近美国顶尖水平,但在涉及智能体能力(Agentic Capabilities)和抽象推理的任务中,差距依然显著。例如,在CAISI内部开发的PortBench测试中,其44%的得分远低于GPT-5.5的78%。

CAISI强调,本次评估采用了包括 PortBench(CLI工具移植测试)和 CTF-Archive-Diamond(网络安全挑战)在内的多个独立且未受污染的基准测试,旨在排除模型在公开数据集上可能存在的记忆现象。

在推理配置上,CAISI使用了云端 H200/B200 GPU 集群,并完全遵循开发者建议的系统提示和思考时间设置。针对PortBench等代理评估,赋予了高达100万加权代币的预算,以确保模型有足够的计算空间进行推理。

CAISI的研究人员表示:DeepSeek V4 Pro是迄今为止我们评估过的性能最强的中国AI模型,它在成本控制上的突破为开发者提供了极具吸引力的选择。然而,从能力时间来看,中国模型目前仍处于追赶美国2025年中期水平的阶段。

随着GPT-5.5等更高阶模型的普及,全球AI领域的“能力阶梯”竞争正进一步加剧。CAISI建议开发者根据任务的复杂程度选择模型:对于高性价比的数学或科学运算,DeepSeek V4极具竞争力;而对于需要极端推理和自主能力的复杂工程,美国前沿模型仍是首选。

CAISI Evaluation of DeepSeek V4 Pro

In April 2026, the Center for AI Standards and Innovation (CAISI) evaluated the open-weight AI model DeepSeek V4 Pro (“DeepSeek V4”).

26 个帖子 - 26 位参与者