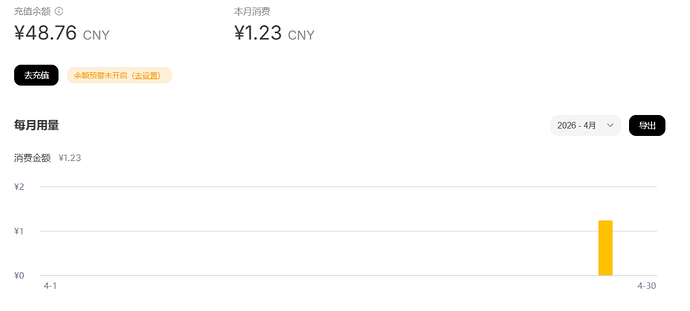

猛蹬一天只花了一块多(我是flash和pro混用),编程能力个人感觉接近GLM5.1,最主要的优点就是特别省token,同样的任务消耗的token数量几乎是其他模型的80%左右,再加上1M的长上下文,真感觉特别适合CC,CX这些智能体。

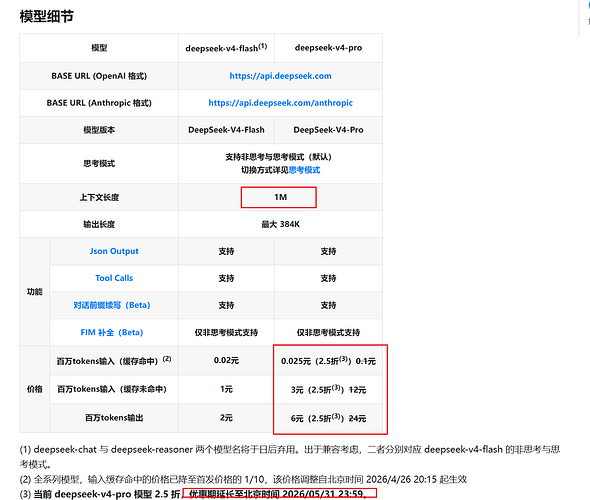

然后今天看了一眼API价格, 官方直接把deepseek-v4-pro的2.5 折优惠延长到 5 月 31 号了!(这似乎是前沿慢讯了,好像改两三天了)

感觉简单业务用DSV4完全没有问题了,复杂业务再用GPT-5.5(个人感觉比ClaudeOpus4.7强,而且Claude太贵了)

最后想问现在佬友们都在用什么模型啊?或者有什么低价中转站推荐么(求私发我)

9 个帖子 - 7 位参与者