老登们下班了,现在可以霍霍服务器了 ![]()

vllm-ascend部署文档: DeepSeek-V4 — vllm-ascend

模型:DeepSeek-V4-Flash-w8a8-mtp · 模型库

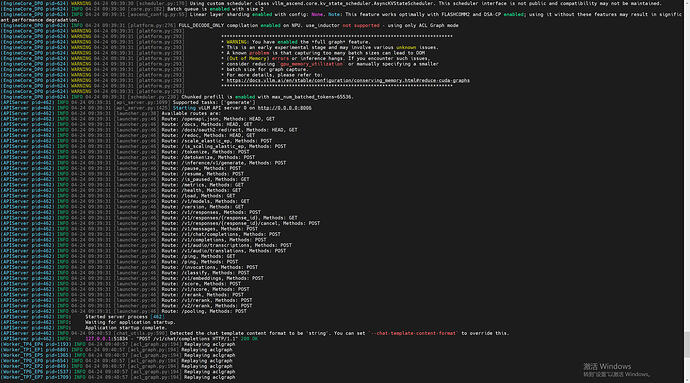

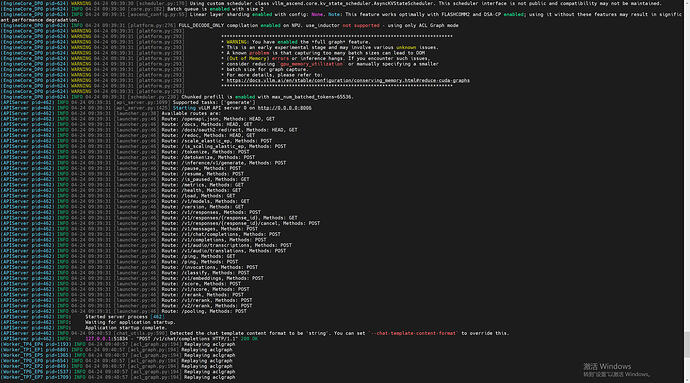

启动成功:

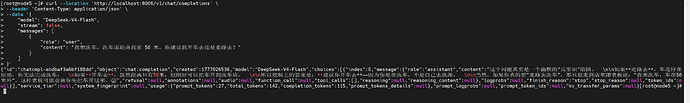

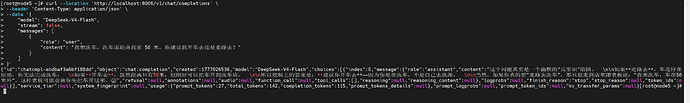

先问一下洗车问题:

逻辑OK

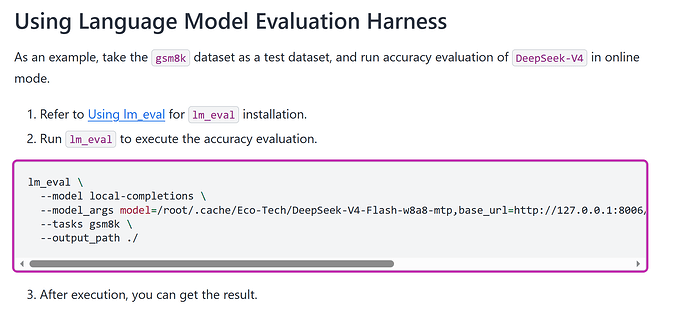

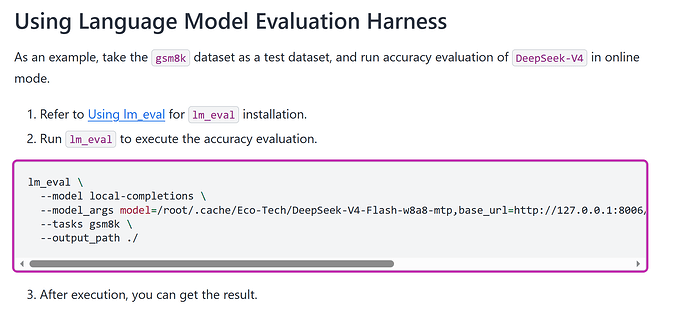

跑一下文档中的数据集(GSM8K,数学推理能力)

速度慢的发指 ,10个并发~290~480 tokens/s

先去吃个饭,吃完再来看一下

2 个帖子 - 2 位参与者

老登们下班了,现在可以霍霍服务器了 ![]()

vllm-ascend部署文档: DeepSeek-V4 — vllm-ascend

模型:DeepSeek-V4-Flash-w8a8-mtp · 模型库

启动成功:

先去吃个饭,吃完再来看一下

2 个帖子 - 2 位参与者

clawmail已经没有用了,只要加入oauth就会稳定跳add phone…甚至免费的都会稳定跳 1 个帖子 - 1 ...

1 个帖子 - 1 位参与者 阅读完整话题...

官方一个用途就是转发验证码。昨天体验了一下,转发不是很快。并且苹果有些注册也能用苹果提供的临时邮箱。感觉用途不是很大。 ...

从X到DY 从傅盛到孙割 有一点最开始人人用小龙虾,那趋势了 1 个帖子 - 1 位参与者 阅读完整话题...

想问问各位佬友知不知道Claude Mac桌面端opus 4.6怎么开启1m上下文呀 1 个帖子 - 1 位参与者 阅读...

最近在开魔法去使用AI时,忽然发现香港节点可以正常使用Gemini了,我记得之前是锁国区的,所以好奇来问问, 3 个帖子...

延展页面 · gxcgpingtai.com

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.dianyoupg.com

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · gxcgpingtai.com

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.tcti.cn

延展页面 · www.yazhupg.com

延展页面 · www.tcti.cn

延展页面 · gxcgpingtai.com

延展页面 · www.tcti.cn