上集回顾[Qwen3.6]27B-FP8 VLLM本地部署主观个人测评

环境:

WLS2 Ubuntu22.04

硬件:

4090 48G

SGLang太佛系了,快一个月了还不更新正式版,需要好好挖掘pr。目前已经找到4090 48G本地部署的版本。

我测试了两个模型。以及DFlash加速方案。

模型:

官方FP8 Qwen/Qwen3.6-27B-FP8 · Hugging Face

HuiHui edp1096/Huihui-Qwen3.6-27B-abliterated-FP8 · Hugging Face

均支持MTP 加速,以及DFlash加速。

SGlang venv环境部署:

uv venv sglang-dev --python 3.12

source sglang-dev/bin/activate

#Ubuntu 可能遇到环境依赖问题,选择性安装

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh -s -- -y

source $HOME/.cargo/env

apt-get install -y protobuf-compiler

#主要安装pr #23190

uv pip install "git+https://github.com/sgl-project/sglang.git@refs/pull/23190/head#subdirectory=python"

老惯例,启动配置脚本附件,参数都在里面,脚本仅为方便调试参数。

启动配置.zip (1.7 KB)

具体可查阅【SGLang】409048G魔改部署 Qwen3.5-27B-FP8&35B A3B一些心得经验分享。

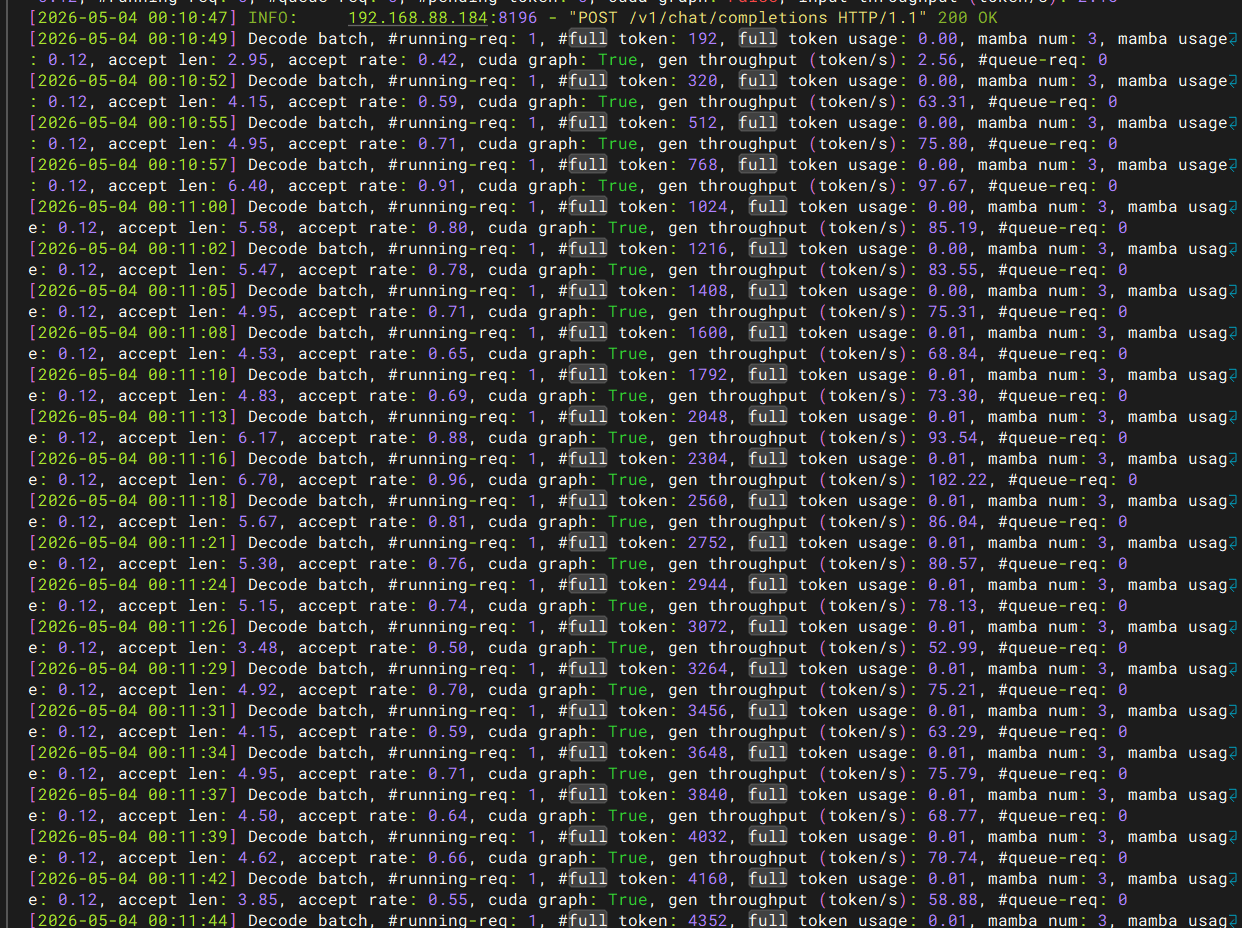

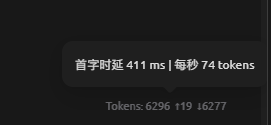

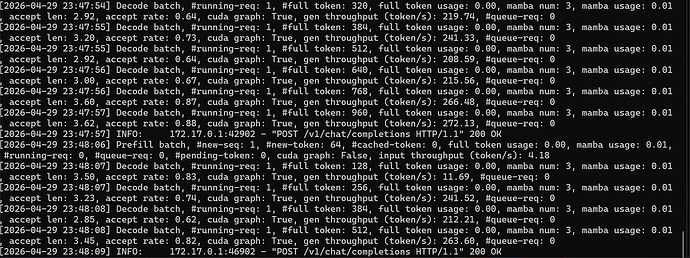

以下是测试截图:

DFlash还属于测试版本,我测试下来,不太稳定,能用,但是没有MTP加速效果快。等正式版发布。

这次主要有一个非常的地方,是我群里的好友提出的,我测试了以后有效。在他大炮RTX6000Pro的硬件下,跑出了单发200+top/s的惊人速度!

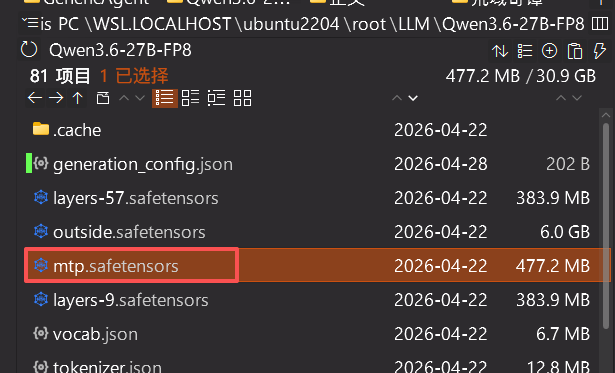

核心:SGLang的配置参数中,指定MTP模型路径!–speculative-draft-model-path

(指向模型文件路径即可)

否则SGLang使用的是自带的MTP模型。Qwen3.6 27B 自带MTP模型,加速效果非常显著!

HuiHui模型非常好用,配合Hermes、GenericAgent等agent,轻松实现各种破限操作。

GenericAgent 强烈推荐由复旦大学研究生团队出品的国产agent 框架,我最近一直在使用,其核心是将skill成功运行以后结晶为SOP,同时在框架中优化上下文截断原理,保证agent在执行任务过程中不被上下文过长的问题造成污染。

指路:GenericAgent

教程:hello-generic-agent

原理(建议阅读):GenericAgent 的第一性原理

后续我会另开帖子详细分享GenericAgent使用体验!

1 个帖子 - 1 位参与者