Release 1.0.13 · google-ai-edge/gallery

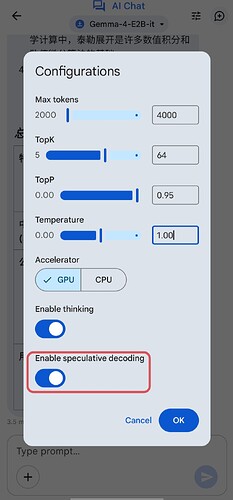

Support Gemma 4's built-in Multi Token Prediction (MTP) to accelerate decoding. Check out the blog post for more details. Try it in AI Chat, Ask Image, Ask Audio, and Prompt Lab (turn on the "Suppo...

需要更新到 v1.0.13 ,下载新的模型文件,并打开这个开关启用

Accelerating Gemma 4: faster inference with multi-token prediction drafters

An overview of how Multi-Token Prediction (MTP) drafters are making Gemma 4 models up to 3x faster at inference.

我们现正为 Gemma 4 系列发布“多词元预测”(Multi-Token Prediction,简称 MTP)草稿模型。通过采用一种专门的推测解码架构,这些草稿模型可在不降低输出质量或推理逻辑准确性的前提下,实现高达 3 倍的推理速度提升。

为何选用推测解码?

从技术现实来看,标准的 LLM(大型语言模型)推理过程往往受限于内存带宽,从而产生了严重的延迟瓶颈。处理器将绝大部分时间都耗费在将数十亿个模型参数从显存(VRAM)传输至计算单元上,而这一切仅仅是为了生成一个词元。这种低效的资源利用导致了计算单元的闲置以及高昂的推理延迟,尤其是在消费级硬件平台上。

推测解码技术将词元的“生成”过程与“验证”过程解耦开来。通过将一个计算开销较大的“目标模型”(例如 Gemma 4 31B)与一个轻量级的“草稿模型”(即 MTP 模型)相结合,我们可以充分利用闲置的计算资源:草稿模型能够一次性“预测”出多个后续词元,且其耗时甚至少于目标模型单独生成一个词元所需的时间。随后,目标模型会对所有这些由草稿模型建议的词元进行并行验证。

推测解码的工作原理

标准的 LLM 采用自回归的方式生成文本,即每次仅生成一个词元。尽管这种方式行之有效,但它存在一个弊端:无论是预测一个显而易见的后续内容(例如在“Actions speak louder than…”之后预测出“…words”),还是解决一道复杂的逻辑推理题,模型所投入的计算资源是完全相同的。

MTP 技术通过推测解码机制缓解了这种低效问题。推测解码是一项由 Google 研究人员在论文《通过推测解码实现 Transformer 模型的快速推理》(Fast Inference from Transformers via Speculative Decoding)中首次提出的技术。如果目标模型认可草稿模型所预测的内容,它便会在单次前向传播计算中全盘接受这一整串序列——甚至在验证的同时,还能额外生成一个属于它自己的新词元。这意味着,在通常仅够生成单个词元的时间内,你的应用程序现在能够输出由草稿模型生成的一整串序列,外加目标模型额外生成的一个词元。

1 个帖子 - 1 位参与者