AI 创新企业 Subquadratic 正式宣布推出 SubQ 1M-Preview。这是全球首个基于全亚线性(Fully Subquadratic)架构的大语言模型。该架构彻底打破了传统 Transformer 模型中计算量随上下文长度呈二次方(Quadratic)增长”的致命瓶颈,实现了计算量随上下文长度的线性增长。

在长达 1200 万 Token 的研究测试中,SubQ 成功将注意力机制的计算量较当前主流前沿模型降低了近 1000 倍,实现了性能、精度的双重飞跃。

传统模型由于每个 Token 都需要与其他所有 Token 进行比对,导致算力需求随文本增长呈二次方爆炸。这使得长文本处理极其昂贵且不稳定,迫使行业不得不依赖 RAG(检索增强生成)、分块(Chunking)和复杂的提示词工程等缝补方案。

SubQ 从底层数学逻辑彻底重构了注意力机制。不仅大幅扩展了上下文窗口,还在大海捞针和精确复制测试中达到了顶尖准确率,同时带来了更快的推理速度和指数级下降的成本。

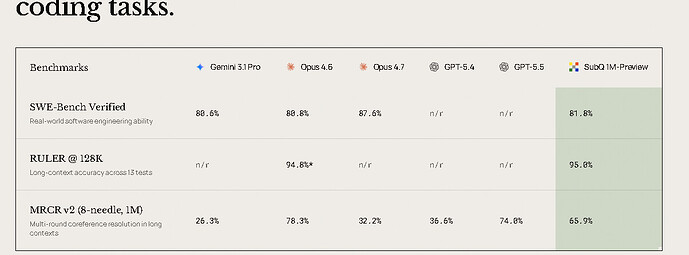

SubQ 1M-Preview 在多项针对长文本和推理能力的权威基准测试中展现出超越主流前沿模型的统治力:

SubQ 的稀疏注意力(Sparse Attention)**机制比 FlashAttention 快 52 倍,同时减少了 63% 的算力消耗。此外,当其他前沿模型在接近其宣称的 100 万 Token 极限时纷纷崩溃时,SubQ 的研究模型在高达 1200 万 Token 下依然运行。

Subquadratic 即日起面向开发者和企业团队开放以下产品的私有测试:

- SubQ API:面向开发者和企业级团队的全上下文 API。

- SubQ Code:基于命令行界面(CLI)的代码智能体(Coding Agent)。得益于庞大的上下文容量,它可以一次性载入整个代码库。开发者可在单一 Context 窗口内完成跨仓库的规划、执行与审查,彻底告别多智能体系统带来的协同开销。

- SubQ Search:一款长上下文搜索工具,能够以聊天机器人的响应速度提供深度研究能力。

https://subq.ai/

Subquadratic — Efficiency is Intelligence

2 个帖子 - 2 位参与者