原来这才是Deepseekv4.0大放水降价背后的真相

应该是DeepSeek发现为V4做了over-prepared,准备过度,结果V4的KV Cache命中率比预想的还要高,不得不(注意是不得不)加大流量,让batch size更大。

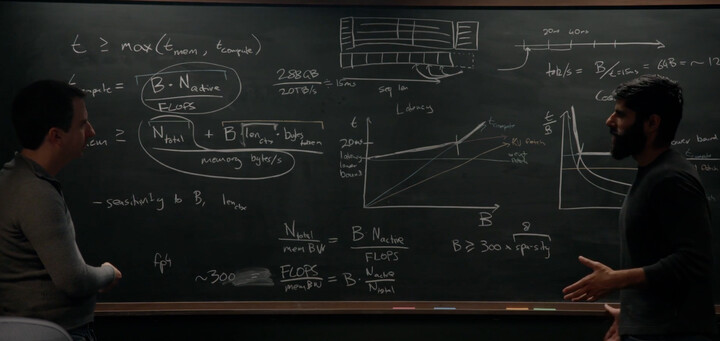

几天前,曾经的Google TPU架构师Reiner Pop做客Dwarkesh的博客(就是上次把黄仁勋气的红温的Dwarkesh),就详细讲解了大模型推理时Batch Size的重要性,虽然Dwarkesh在中美关系上屁股很歪,但是,他请的嘉宾水平都很高,这次Reiner也讲得很清楚,甚至都上了黑板板书。

简单说,LLM 的推理,受限更像是内存带宽,而不是纯计算。

因为,每生成一个 token,都要反复读取模型权重和 KV Cache,Batch Size 越大,就越能把一次加载模型权重的开销分摊到更多请求上,GPU 的计算利用率也更高,因此每个请求的平均成本下降。

但是有一个问题,Batch Size变大,通常意味着系统会把更多请求一起处理,这会提高吞吐量,但也会让单个请求等待更久,尤其是小请求可能要等大 batch 组满或轮到执行。

所以基于这些考虑,Batch Size大小选择就是做权衡:更大的 batch 通常更便宜,但单请求延迟更高。

理解了上面这些,再看DeepSeek延长2.5折这件事,逻辑就通了。

DeepSeek肯定为V4准备了大量推理算力,大到他们自己都没想到V4这么『省』,V4的架构优化(更激进的KV Cache压缩)让GPU计算和带宽消耗远低于预期,KV Cache命中率也高出规划。

这意味着啥呢?

意味着DeepSeek手里落下一大堆闲置推理算力(训练算力估计怎么都闲不下来)。

算力如果闲置就是纯成本,GPU不像咱自家电脑,不用刻意关掉,观点就不耗电,数据中心的GPU只要开着,不管干不干活,电费、冷却、折旧一分不少,时刻都在烧钱。

所以2.5折与其说DeepSeek是在做慈善,比如说是在给自己止血。

与其让GPU空转烧钱,不如把价格打到地板上,用低价把流量灌进来,把Batch Size撑大,这样单次请求成本越低,GPU利用率更高,平均成本就更低。

还有一个问题,为什么不直接把2.5折定为正式价格,非要只是特价延长到5月31日?

因为定价策略和成本结构是两回事。

2.5折是当前算力过剩状态下的最优定价,但DeepSeek不确定这个状态会持续多久,随着V4用户量增长,某个时刻会到达一个拐点,再往上加用户,延迟就开始劣化了,到那时候价格就该往回调了。

用『特价延长』而不是『永久降价』,给DeepSeek留了回旋余地。

说到底,DeepSeek在用2.5折告诉市场一件事:V4的推理效率高到我算力都用不完。

这不光是价格战,也是心理战。

如果DeepSeek是我2.5折可能还有利润,其他模型原价可能还在亏钱,这还怎么跟?

V4太省了,省到DeepSeek必须把价格打到2.5折,才能吸引足够多的流量才能充分利用GPU。

这可能是世界上最顶级的凡尔赛:-)

这说明国产越来越好了,大家有什么看法吗

参考信源

9 个帖子 - 7 位参与者