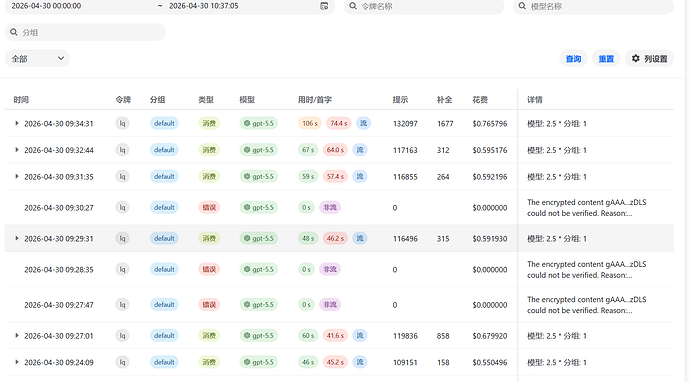

这个 400 不是普通模型失败,也不是模板组装失败。它基本是 Responses API 的 reasoning.encrypted_content 无法被当

前上游解密/校验。

OpenAI 的 Responses API 支持 reasoning.encrypted_content,用于 store:false / 无状态场景,把上一轮 reasoning

item 加密后带到下一轮继续用。官方文档说明这个字段是为了让无状态 Responses API 也能在多轮里复用 reasoning ite

ms。(developers.openai.com (Responses | OpenAI API Reference))

你的报错:

The encrypted content gAAA… could not be verified.

Reason: Encrypted content could not be decrypted or parsed.

对应场景通常是:请求体里带了上一轮返回的加密 reasoning 内容,但这次转发到了 不能解密它的上游 key / organizat

ion / deployment。LiteLLM 的事故报告里明确说过,Responses API 的 encrypted reasoning items 会和创建它们的 Op

enAI organization / API key 绑定;负载均衡到不同 API key 或不同 organization 后,后续请求会 400 invalid_encr

ypted_content。(docs.litellm.ai (Incident Report: Encrypted Content Failures in Multi-Region Responses API Load Balancing | liteLLM))

8 个帖子 - 5 位参与者