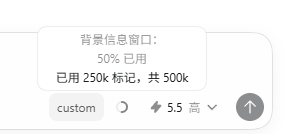

今天codex更新,发现gpt5.5只有250k的上下文,之前在toml中的model_context_window配置似乎失效了。

那么依旧找gpt5.5自己尝试解决一下,啪的一下很快啊。

新版 Codex 里,model_context_window = 500000 可能无效,是因为客户端会先查模型 catalog。若模型 slug 没被 catalog 正确认出,例如 gpt-5.5,它会走 fallback metadata:context_window = 272000,再乘 effective_context_window_percent = 95,所以实际显示 258400。单独写 model_context_window 会被 max_context_window clamp,不能突破。

解决办法是用 model_catalog_json 自定义模型元数据。

- 在 ~/.codex/config.toml 增加:

model = "gpt-5.5" model_context_window = 500000 model_auto_compact_token_limit = 450000 model_catalog_json = 'C:\Users\你的用户名\.codex\model_catalog_custom.json'

- 新建 ~/.codex/model_catalog_custom.json,核心是让 gpt-5.5 有这些字段:

{ "models": [ { "slug": "gpt-5.5", "display_name": "gpt-5.5", "context_window": 500000, "max_context_window": 500000, "auto_compact_token_limit": 450000, "effective_context_window_percent": 100, "supported_in_api": true, "visibility": "list" } ] }实际使用时最好不要只写这么少字段,而是从现有 ~/.codex/models_cache.json 复制 gpt-5.4 那整段模型 metadata,改 slug/display_name/context_window/max_context_window/auto_compact_token_limit/effective_context_window_percent,这样不会丢 reasoning、tools、instructions 等能力字段。

- 完全退出 Codex 再重开,新线程里看 model_context_window 应该从 258400 变成 500000。

感谢指出

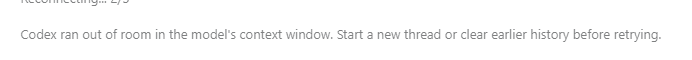

这个设置对 5.5 是无效的,服务器会校验输入是否 <272k tokens 左右

大概到270K时触发服务端报错:

洗洗睡了,只能说相比不改能多用个几十K,然并卵。

5 个帖子 - 3 位参与者