最开始看到 gpt-image2 的时候,其实是带着一点怀疑的。 OpenAI 早期那几代 DALL·E,用过的人都知道,能出图,但始终被 Midjourney、Stable Diffusion 压着一头。细节、质感、审美控制,几乎每一项都差一截。后来 Sora 相关入口一度收紧,文生视频这条线也变得不那么明朗,于是对它在图像和视频方向的能力,自然不会抱太高预期。

在这样的背景下,再看这个新模型,很难会去关注。

直到第一批图开始在抖音上流动。

那种感觉不太像“画得更好了”,更像是某个边界被悄悄抹掉了。

有人发了一张教室照片。不是那种构图规整、光线漂亮的素材图,是国内很普通的高中教室。桌面有划痕,黑板边缘有粉笔灰,窗外光线偏白,带一点过曝。最怪的是人——没有刻意的“好看”,有的低头,有的侧脸,有人被前排挡住一半。脸不完美,甚至有点糊,但整体成立。

另一张是家庭合照。像是十几年前的旧相片,边缘微微泛黄,画面有一点不均匀的模糊。不是滤镜那种“统一处理”的模糊,而是镜头、时间、存储共同留下的那种不稳定感。人物站位有点挤,表情不统一,有人笑得晚了一拍,有人眼睛没完全睁开。

这些都还在“可以理解”的范围。

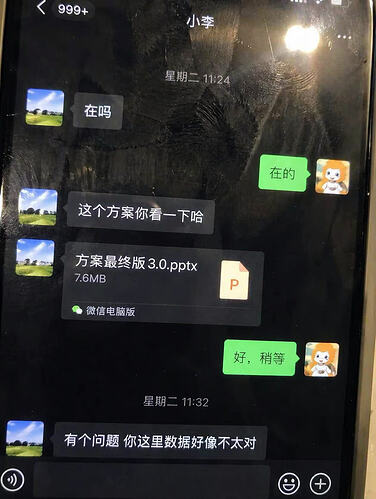

直到看到那张聊天截图的照片。

一张不该成立的图

就是你看到的这一张。

第一眼不会觉得哪里不对。

甚至会下意识当成“别人随手拍的一张手机屏幕”。

但如果慢慢看,会发现一些原本不会被生成模型处理的细节,全都在:

屏幕上那层不均匀的指纹痕迹,不是简单叠一层贴图,而是随着光源方向变化,有明有暗,有重有轻。

顶部那一块反光,压住了一部分内容,但又没有完全遮住,像真实环境里的灯光。

聊天气泡的边缘,有轻微的拍摄失真,不是UI本身的问题。

甚至连画面整体的那种“糊”,也不是算法降清晰度,而是拍照时的手抖、焦点偏移、玻璃反射一起造成的。

这种东西,过去的模型基本不会碰。

因为它不属于“内容”,属于“错误”。

但这一版,把这些“错误”当成了真实的一部分。

人开始不像“AI生成的人

之前生成的人脸,有一个共性。

太完整。

五官对称,皮肤干净,光影合理,每个人都像精修过的样片。哪怕加一点噪点,依然能看出那种“被认真画过”的痕迹。

现在不一样了。

有的人脸略微偏斜,有的人表情卡在一个中间状态,有人被遮挡,有人没对上焦。

有些地方甚至不太“好看”,但整张图反而更像真实世界。

那种统一的“完美”,开始消失。

取而代之的是一种不稳定,但成立的自然感。

模糊也开始变得可信

旧照片一直是一个很难处理的场景。

不是做旧,而是“像真的旧”。

以前的结果,大多是统一加一层泛黄,再叠一层颗粒,最后降一点清晰度。远看可以,近看很假。

这一次,模糊不再是统一处理。

有的地方清楚,有的地方虚掉;

有的边缘有拖影,有的地方像被压缩过;

颜色也不是简单变暖,而是带一点褪色后的不均匀。

这些细节拼在一起,才会让人相信这是“某个时间留下来的照片”。

那条已经变模糊的线

这类变化,单看每一点都不算惊人。

指纹、反光、模糊、轻微失真,这些都可以单独模拟。

问题在于它们被放在同一张图里,而且没有明显的拼接痕迹。

过去判断一张图是否为生成,往往依赖某个破绽。

现在更像是在寻找“有没有哪里不对劲”,而不是“哪里明显是假的”。

判断标准本身在变化。

5 个帖子 - 5 位参与者