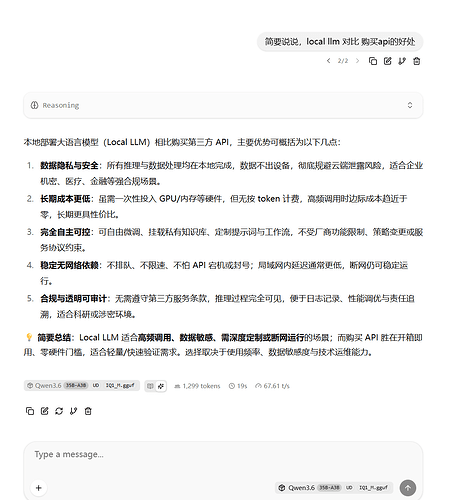

我是windows上llama.cpp部署的,先看效果图。

这里面,我用的模型是 unsloth 量化的 Qwen3.6-35B-A3B-UD-IQ1_M 模型。

得益于其超强的量化,整个模型可以完美装在 2080ti 11g 显存里面,用 q4 量化上下文可以跑到128k 的上下文。

单并发 67 tps 的速度,如果2-4并发最多可以翻倍tps。

模型性能

跑在 pi-coding-agent 里面绰绰有余,

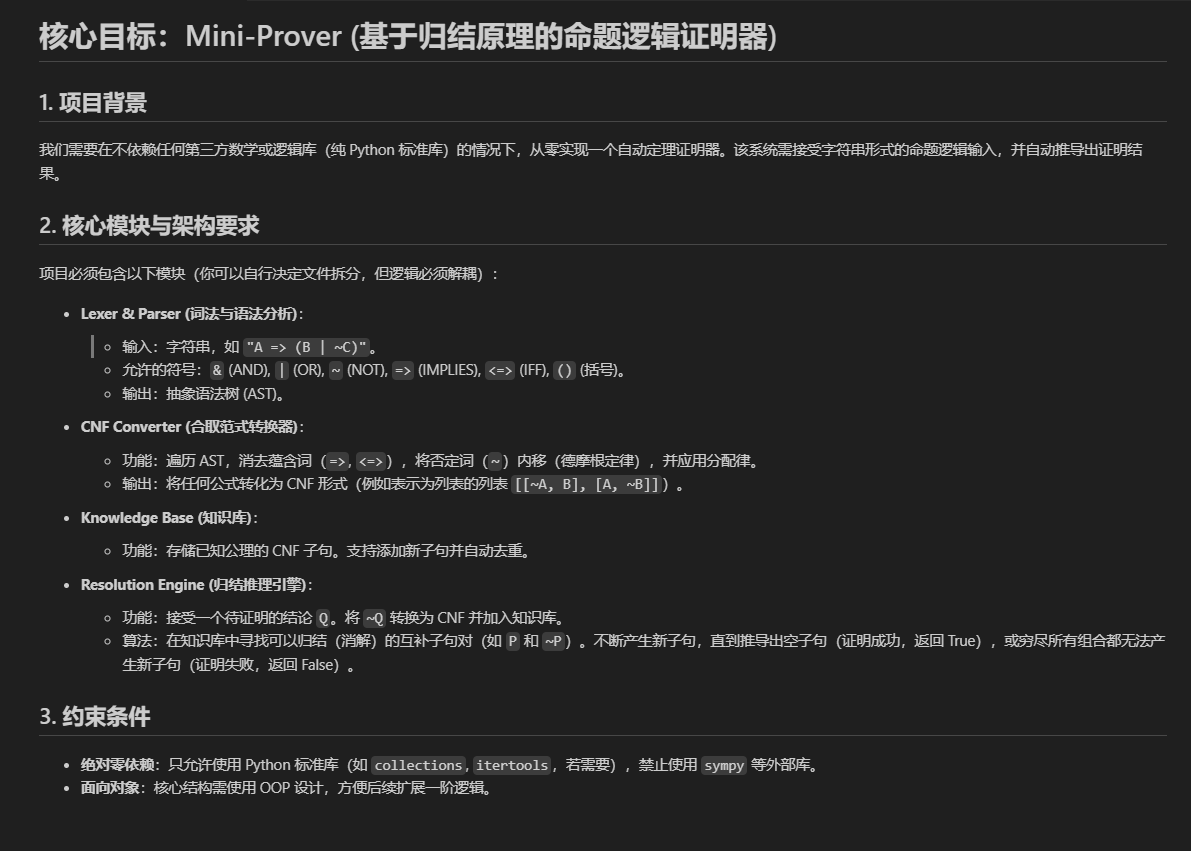

我让他复现了一个自动证明系统,要求如下

最后也是保质保量完成了,而且自己跑通了测试流程。

为什么不用qwen 3.6 27B

我下载了qwen 3.6 27B 比较小的量化版本,可以全部跑在显存里面,但是上下文只有32k而且tps只有22左右,而且我接入 pi-coding-agent 里面还发生了死循环,感觉不太可用,虽然网上说 27B 版本很牛,但是我还是觉得moe版本的更好。

有什么用

本地部署可以搞一些隐私数据,其他我觉得真的不如薅点免费或者低价的api。

接入openclaw应该是能玩的,但是电费成本算下来不一定打得过低价api。

不过在二手1200元左右淘到的2080ti上跑起来agent还是很有成就感的

简单的 benchmark

用了 GitHub - stevibe/BenchLocal: Test LLMs on real tasks. Compare models side-by-side. · GitHub 这个来做测试。跑的是其中这个 DataExtract-15 benchmark。

对比模型找了好久,感觉不是很能找到主流的更弱的模型。

注意,这个 Qwen3.6-35B-A3B-UD-IQ1_M 是超级量化版本,不代表 Qwen 该模型满血水平。

注: deepseek用的zenmux api,然后Step用的魔搭api,然后glm是学校本地部署的,我猜是4.7模型。

结论 :勉勉强强能打step 3.5 flash,也是没出乎意料垫底了。

碎碎念(如果你也想部署)

- 想清楚自己想要什么,如果load一点模型到内存里面,会减至少一半tps,但是上下文更多,能跑的模型更好。

- 具体运行代码

\llama-server.exe -m "C:\Users\……\Qwen3.6-35B-A3B-UD-IQ1_M.gguf" -c 131072 -ngl 99 --parallel 1 --flash-attn on --cache-type-k q4_0 --cache-type-v q4_0 -b 512 -ub 64 --port 8080 --host 0.0.0.0,这是没加载识图模型的版本,qwen该模型支持识图,但是显存开销会变大。 pi-coding-agent很轻便,很好用,适合本地模型。

1 个帖子 - 1 位参与者