-

我的帖子已经打上 开源推广 标签: 是

-

我的开源项目完整开源,无未开源部分: 是

-

我的开源项目已链接认可 LINUX DO 社区: README 已添加链接

-

我帖子内的项目介绍,AI生成、润色内容部分已截图发出: 是

-

以上选择我承诺是永久有效的,接受社区和佬友监督: 是

一、前言

之前用NewAPI,就是有点重,比较适合中转站,和自用不太一样。

遇到的问题如下:

-

有时候需要看请求完整内容

-

模型价格需要配置和同步

-

接口格式转换稳定性很玄学

-

用户管理、余额功能用不到

遂开发了一个自用的网关 GitHub - GoJam11/LLMRelayService · GitHub

二、基础使用

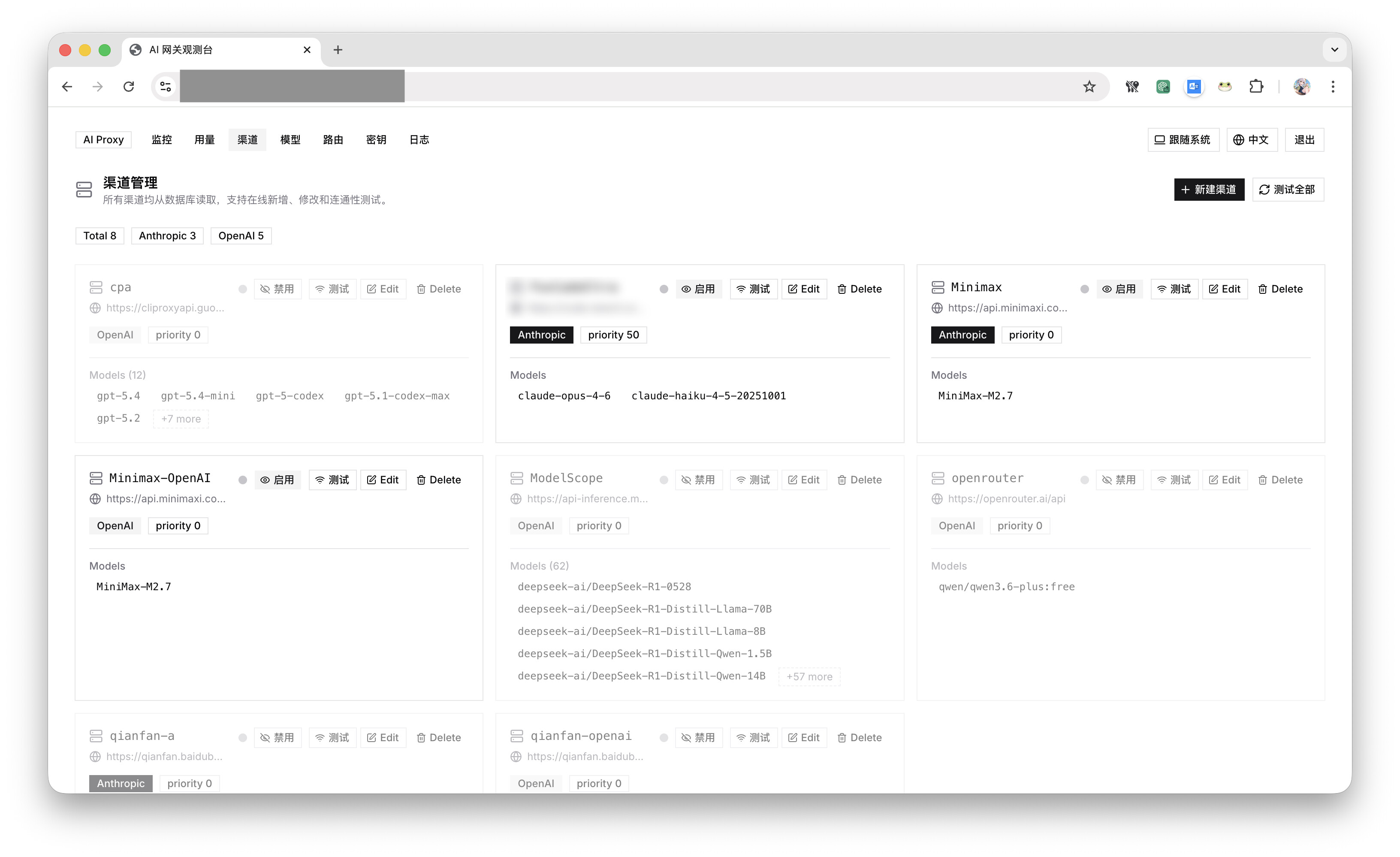

支持配置 openai 和anthropic 上游,可以直接使用v1/chat/completions 等端点。

三、高级功能

指定渠道

请求时可以加/providers/{channelName}指定上游

路由别名

支持将任意model name 映射到providers.model。下游应用可以配置"Auto"模型。

请求日志

可以查看首Token 耗时、总耗时、Token 消耗和缓存、价格

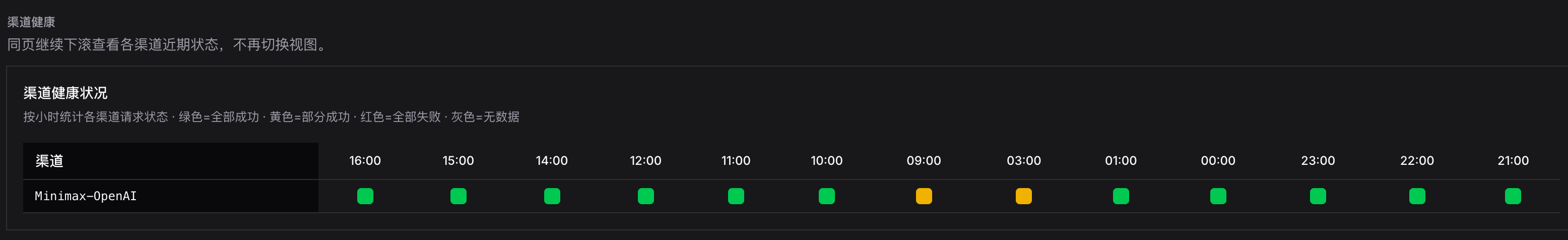

渠道健康

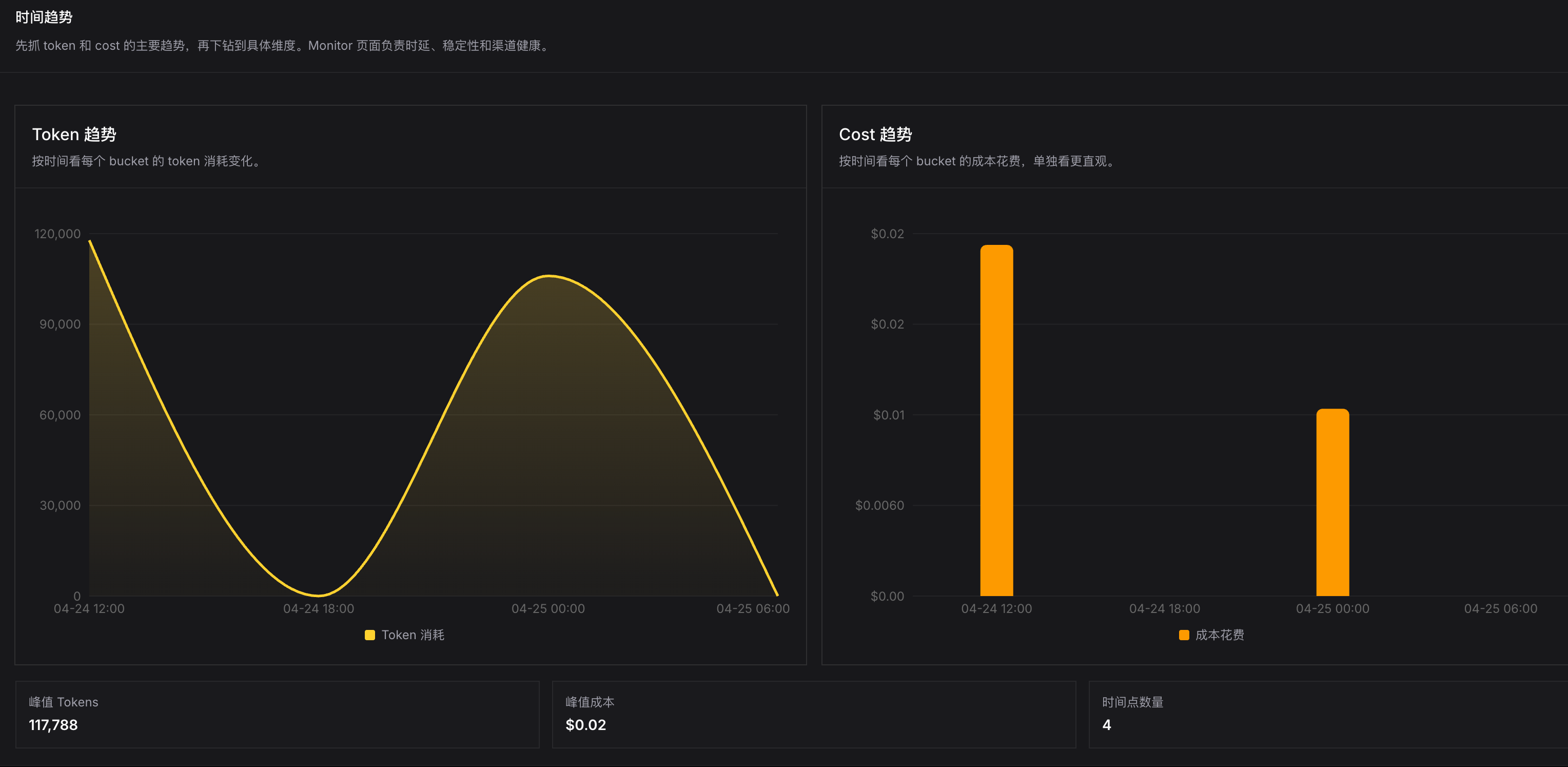

使用趋势

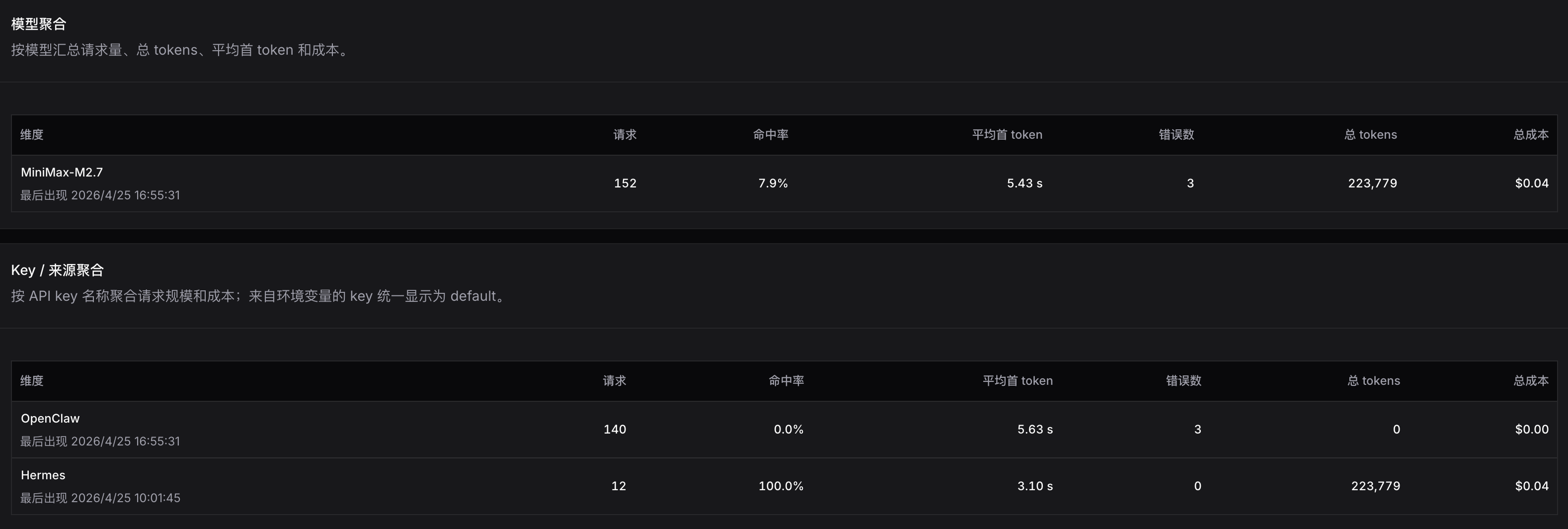

模型和来源聚合

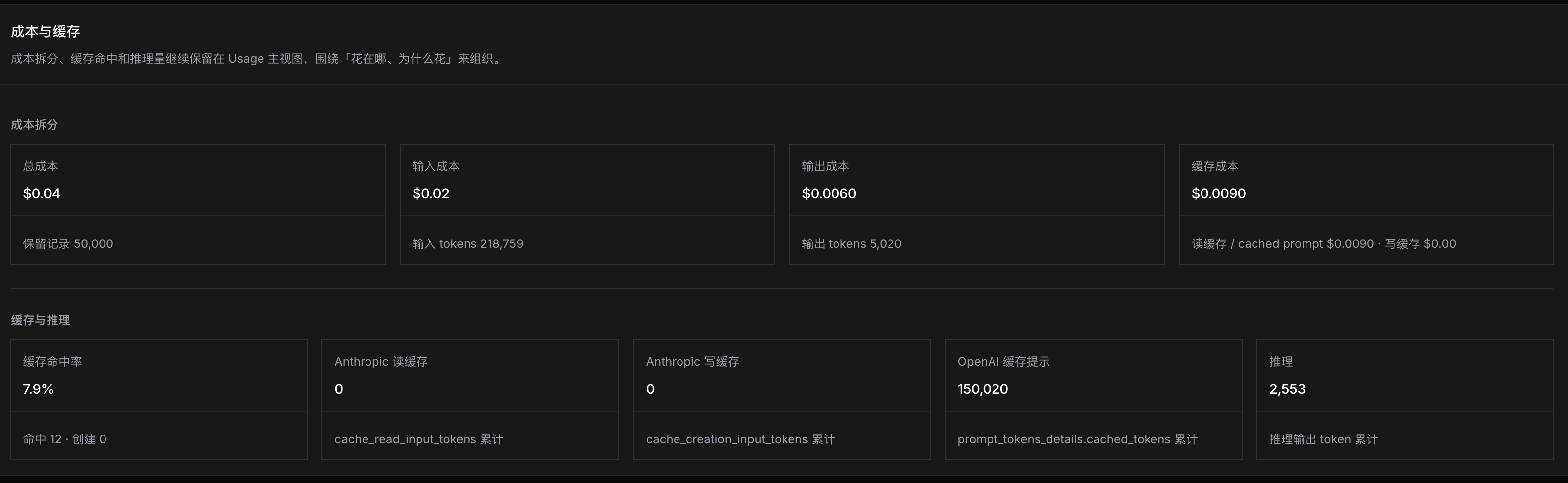

成本和缓存

仓库地址: GitHub - GoJam11/LLMRelayService · GitHub

这个项目起初是为了接入各种中转上游做的,可以清楚看到各个上游的成功率等数据,包括coding plan。

如果对你有帮助,欢迎 Star~ 也欢迎提意见

2 个帖子 - 2 位参与者