很久没有写博客类文本,已经不知道怎么开场了,直接开始吧首先需要把 Claude Code 更新到 1.0.61 及以上版本,Anthropic 在这个版本给 Claude Code 添加了 --settings 选项, 这个也是实现原生多模型供应商配置的切入点 [image] Claude Code Changelog [image] 现在开始配置,打开用户目录下的…

接上一个帖子

这两天看到了 DeepSeek V4 Lite / V4 API 要上线的消息,心里想着又了 1M 上下文之后,Cladue Code × DeepSeek V4 可以爽用了。

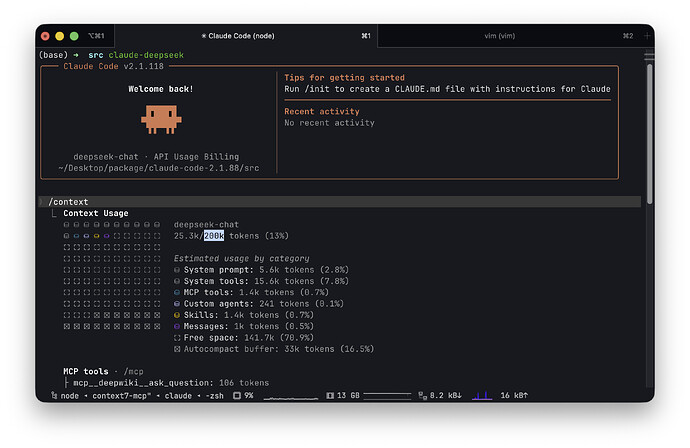

紧接着产生一个疑问,Claude Code 是怎么识别自定义模型的上下文长度的?目前配置的 DeepSeek 在 Claude Code 中默认的上下文长度是多少?

DeepSeek 自定义模型配置:

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx",

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"API_TIMEOUT_MS": "600000",

"ANTHROPIC_MODEL": "deepseek-chat",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-chat",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-chat",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-reasoner"

}

}

用/context 命令看了一下,Claude Code 默认会认为模型的上下长度是 200K。想到之前 Sonnet / Opus 测试 1M 上下文模型的时候要用 /model sonnet[1m] 来进行指定,[1m] 这个上下文标识符可能是个突破口。

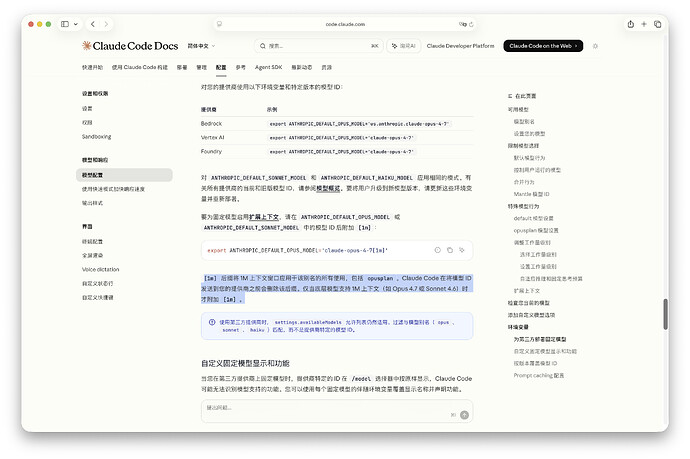

翻看了一下官方文档,找到了如下描述:

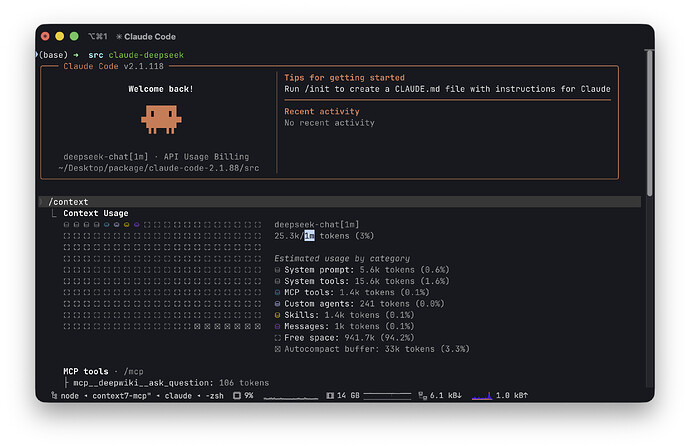

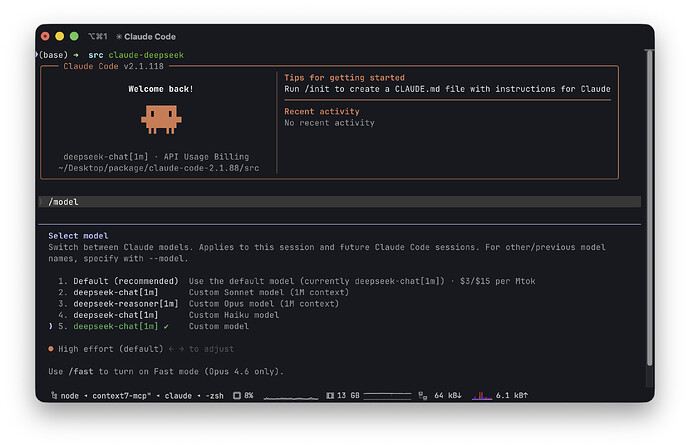

抱着试一试的想法,我修改了自定义模型配置,给模型名称后添加了 [1m] 标识

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx",

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"API_TIMEOUT_MS": "600000",

"ANTHROPIC_MODEL": "deepseek-chat[1m]",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-chat[1m]",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-chat[1m]",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-reasoner[1m]"

}

}

重新打开 Claude Code,使用 /context 命令再次查看

上下文大小成功识别为 1M,由于之前的源代码已经泄漏了,马上让 DeepSeek 驱动的 Cladue Code 去调查一下上下文容量判断的具体依据是什么 ![]()

6 个帖子 - 3 位参与者