今天倒腾了一下 Claude Code 直连官方 Deepseek 的配置,目标是启动 1M 上下文和默认启动 Max thinking mode. 最终配置流程:

-

下载 Claude Code

-

去 Deepseek API 申请 API key 并充值

-

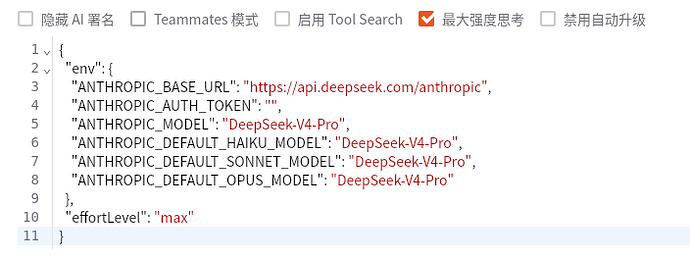

打开

~/.claude/settings.json(Ubuntu, 其他系统应该也是找类似的配置文件) 写入:{ "env": { "ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic", "ANTHROPIC_AUTH_TOKEN": "sk-你的key", "ANTHROPIC_MODEL": "deepseek-v4-pro[1m]", "ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash[1m]", "ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro", "ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro[1m]", "CLAUDE_CODE_EFFORT_LEVEL": "max", "CLAUDE_AUTOCOMPACT_PCT_OVERRIDE": "80" } } -

Terminal 进入 claude code 应该就可以启用了。

效果:

- 默认使用 Deepseek-V4-Pro + 1M 上下文 + max thinking effort,直接可用。

- 切换到不带

[1m]尾缀的模型,上下文变成 200k,这个是 claude code 自己决定的,和 Deepseek 无关 - “CLAUDE_AUTOCOMPACT_PCT_OVERRIDE”: “80” 表示上下文窗口填充 80% 触发 auto-compact

参考官方:Deepseek API Docs: Integrate with Claude Code

关于 CC-Switch

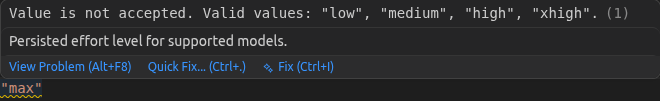

使用 CC-Switch 的话,配置好模型名称之后一定要改一下它自带的一些配置,例如你如果选了最大强度思考,他这里默认在 json 顶层加 "effortLevel": "max",但实际使用会自动 fallback 到 high,因为在 IDE 里可以看到警告 Value is not accepted. Valid values: ... 如下图:

原因是 settings.json 的顶层 effortLevel 字段有 schema 枚举校验,只接受四个值,"max" 不在枚举中直接被拒。但 /effort 命令和 CLAUDE_CODE_EFFORT_LEVEL 环境变量不走 schema 校验,所以 max 能正常生效。

因此一定要像上面一样写进环境变量里。

CCS 本地路由模式

这里是走 DeepSeek BYOK 直连的配置,另外还有关于 CCS 本地路由模式如何开启 1M 上下文的方法:cc-switch issue #2337

ps.

参考其他佬友的帖子:Claude code接入deepseek v4默认是200k上下文

CC环境变量用法:Environment variables - Claude Code Docs

1 个帖子 - 1 位参与者